Adsrekt

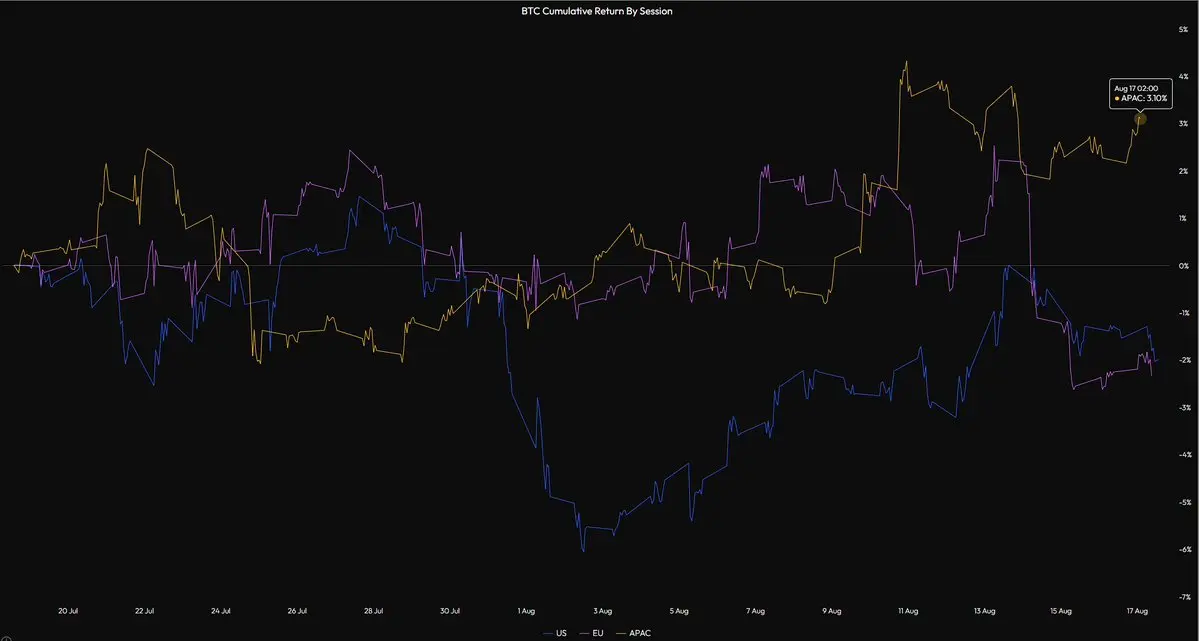

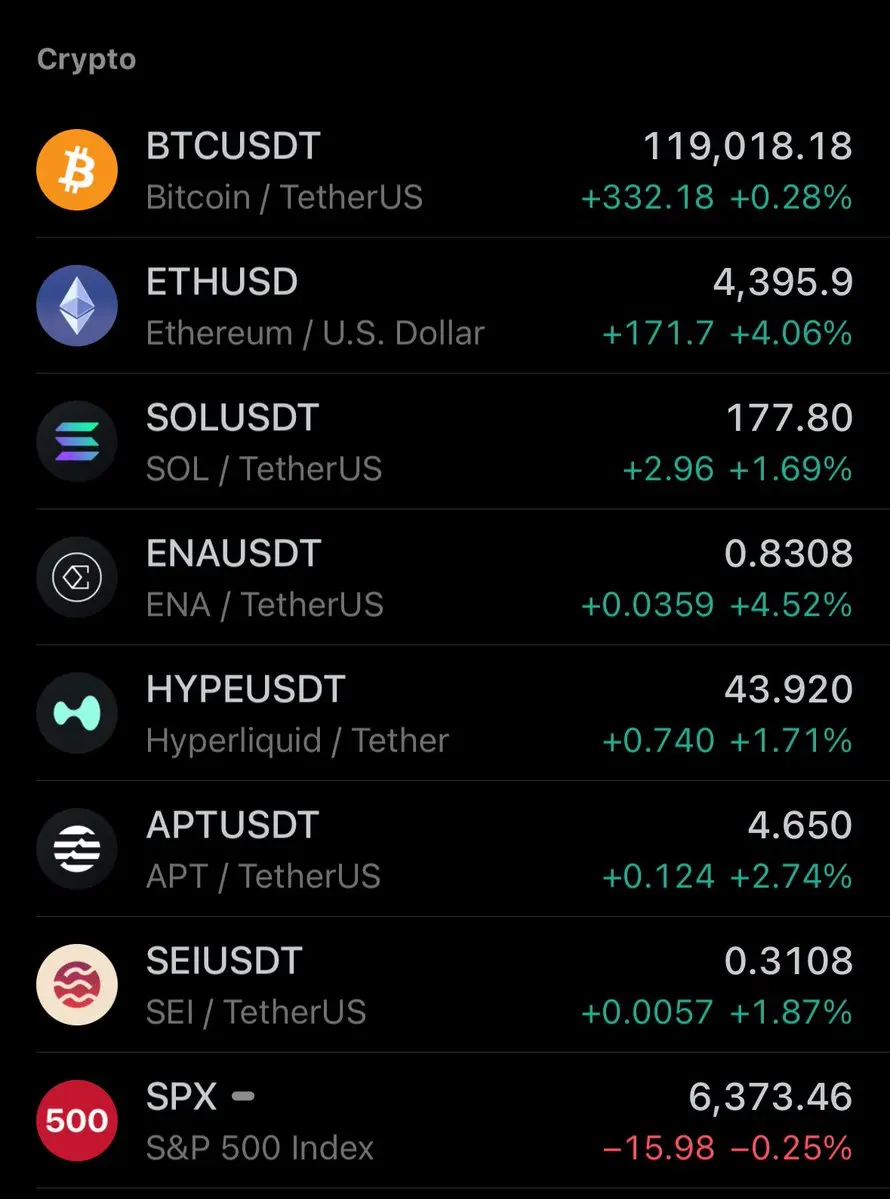

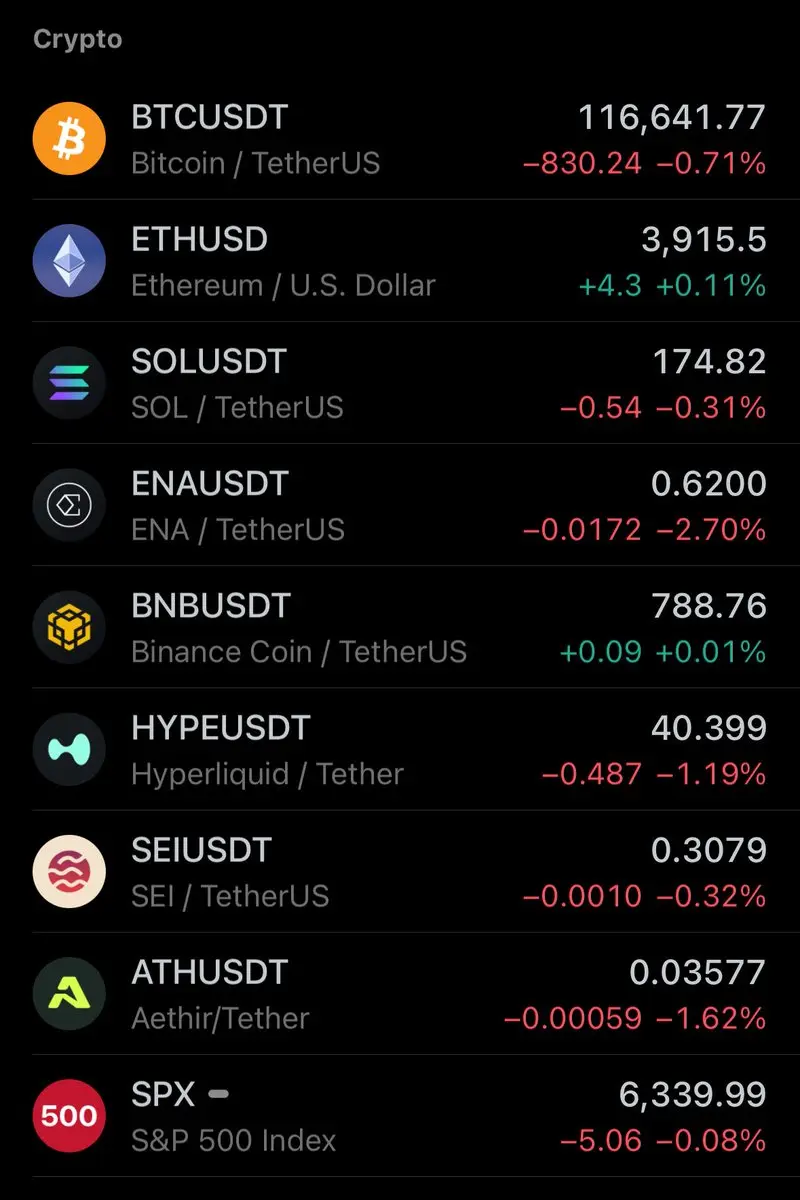

$BTC

volvemos al nivel rosa de plano

en este rango todo ha sido negociado

debe haber algún tipo de movimiento fuerte

especialmente considerando las negociaciones de Trump sobre Ucrania en este momento

la escalada del conflicto será un mejor factor de crecimiento que incluso la reducción de tasas en 50 puntos básicos o más

vamos a ver

Ver originalesvolvemos al nivel rosa de plano

en este rango todo ha sido negociado

debe haber algún tipo de movimiento fuerte

especialmente considerando las negociaciones de Trump sobre Ucrania en este momento

la escalada del conflicto será un mejor factor de crecimiento que incluso la reducción de tasas en 50 puntos básicos o más

vamos a ver